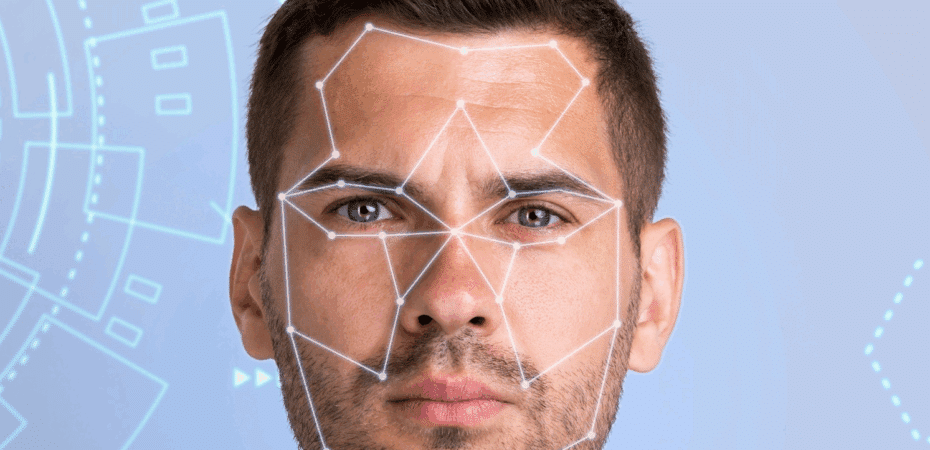

Los ciberdelincuentes están cada vez más utilizando la inteligencia artificial (IA) como un recurso para perfeccionar sus tácticas de fraude. Esto no solo ha permitido que sus engaños sean más sofisticados, sino que también los ha hecho más difíciles de detectar y desmantelar.

Recientemente, se han hecho virales falsificaciones de videos que suplantan a figuras públicas de renombre mundial, como Lionel Messi, Ferrari y Elon Musk, entre otros. El uso de tales tecnologías para crear contenido manipulador ha suscitado preocupación a nivel global.

Sin embargo, este fenómeno no se limita solo a las celebridades; también ha habido casos que involucran a personas en escalas más pequeñas, como un director de finanzas en una empresa de Estados Unidos. La compañía Eset, especializada en la detección proactiva de amenazas, ha podido verificar varias instancias de Deepfake que han resultado en pérdidas millonarias.

Un claro ejemplo de esto es Almohadilla, una tecnología avanzada que utiliza IA para crear imágenes humanas falsificadas desde cero. Este proceso implica el uso de vídeos existentes e incluso imágenes estáticas, formulando representaciones que imitan la apariencia y el sonido de individuos reales con asombrosa precisión.

«A medida que avanza la IA, los vídeos y audios generados parecen cada vez más auténticos. Muchos de estos fraudes utilizan la identidad de figuras públicas o entidades reconocidas para engañar a las personas, solicitando dinero o información sensible», explica Camilo Gutiérrez Amaya, jefe del Laboratorio de América Latina de Eset.

Casos reales y recientes de Deepfake

Lionel Messi: En este caso, los ciberdelincuentes aprovecharon la popularidad de Messi para promover un fraude relacionado con Almohadilla. A través de esta tecnología, promovieron una aplicación que prometía ganancias rápidas y fáciles. En un video manipulado, Messi afirmó que esta aplicación era una de sus fuentes de ingresos, animando a la gente a unirse.

La aplicación en cuestión era «Wildcat Dive». Los estafadores difundieron fragmentos de una entrevista genuina que Messi había dado a un programa argentino, manipulando el contenido para incluir el falso testimonio.

ARUP: A inicios de 2024, la famosa firma de arquitectura, conocida por diseñar la Ópera de Sídney y el Estadio Etihad, fue protagonista de un escándalo. Un empleado de la oficina financiera aceptó una videollamada que decía ser de su director financiero, lo que resultó en 15 transferencias summando más de 25 millones de dólares. Sin embargo, el interlocutor era en realidad un Deepfake, y las transferencias fueron autorizadas engañosamente.

Ferrari, WPP y una escuela

Ferrari: En este incidente, un ciberdelincuente intentó llevar a cabo un fraude usando la tecnología Deepfake, suplantando la voz de Benedetto Vigna, el CEO de la compañía automotriz. En julio de 2024, se trató de convencer a los gerentes financieros de transferir una gran suma de dinero. No obstante, un empleado notó inconsistencias en la llamada, lo que desató la alerta y permitió impedir el ataque.

WPP: Otra víctima potencial de este tipo de fraude fue la reconocida agencia publicitaria. A mediados de 2024, los atacantes usaron una cuenta falsa de WhatsApp y un audio manipulado de una reunión virtual para suplantar a Mark Read, el CFO de la compañía. Intentaron organizar una reunión fraudulenta y solicitar dinero y datos confidenciales, pero el intento fue frustrado gracias a la vigilancia existente y formación del personal.

Escuela de Baltimore: Este fenómeno no solo afecta a las grandes corporaciones; también se ha registrado en instituciones educativas. Un caso involucró a un director escolar que fue objeto de un Deepfake que alteró sus declaraciones, haciéndolo parecer racista y antisemita. Esto llevó a que el video se volviera viral, generando amenazas de muerte contra él. Posteriormente, las autoridades confirmaron que se trataba de un material manipulado por IA.

Otros casos de Deepfake

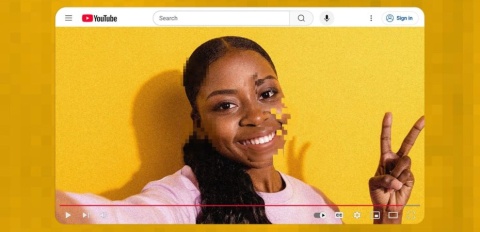

Elon Musk: Un fraude relacionado con inversiones en criptomonedas utilizó la imagen de Elon Musk para diseminar anuncios engañosos en plataformas como X y YouTube, ofreciendo supuestas oportunidades de inversión en Bitcoin. Los anuncios incluían un enlace a un sitio web fraudulento, donde las víctimas eran inducidas a hacer depósitos iniciales.

La Comisión Federal de Comercio de los Estados Unidos reportó que este engaño, que incluyó Deepfakes, resultó en pérdidas que superaron los 80 millones de dólares, afectando a más de 7,000 personas que picaron el anzuelo.

Presidente de Zelensky: En marzo de 2022, un video apócrifo que hacía un llamado al presidente ucraniano Volodimir Zelensky para que abriera fuego fue difundido. Este engaño provocó una rápida respuesta de Zelensky, quien emitió un video auténtico en sus canales oficiales para desmentir el contenido falso.

Recomendaciones para la prevención

ESET comparte numerosas prácticas recomendadas para minimizar el riesgo de caer víctima de tales fraudes:

- Desconfíe de los anuncios que parecen demasiado buenos para ser verdad, especialmente aquellos que involucran a personalidades conocidas.

- Preste atención a la calidad del video; errores visuales, mala sincronización y baja resolución son indicativos de un posible Deepfake.

- Utilice software de seguridad en todos los dispositivos para bloquear correos fraudulentos y contenido malicioso.

- Las empresas deben implementar métodos de validación como códigos internos o palabras clave para autorizaciones en pagos, no solo mediante llamadas o videoconferencias.

- La formación continua es clave para que los empleados reconozcan las señales de alarma de potenciales fraudes Deepfake.

- Utilice herramientas disponibles para detectar Deepfakes y combatir la desinformación.